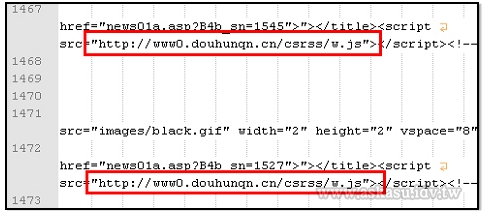

前陣子朋友找我求救,因為他們公司的官方網站,每個頁面都被植入了惡意連結。本來以為是網頁程式碼被塞入連結,仔細檢查才發現,其實是時下最流行的駭客手法-SQL Injection。

復原方式沒什麼好提的,就只是把備份的資料庫倒回去罷了;網頁是外包廠商開發的,我們也不可能一一找出哪段程式出了紕漏。

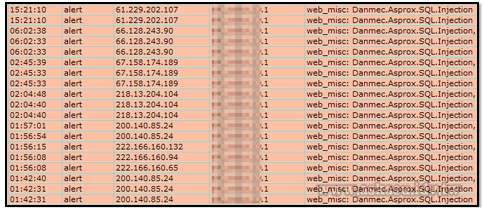

即使這樣,還是協助把他們的UTM 檢查了一下,果然防火牆有偵測到攻擊。

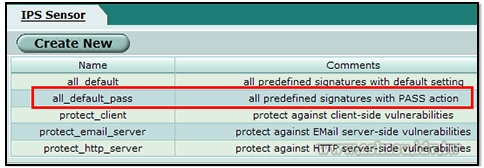

不過為什麼沒有擋下,原來套用的IPS 防護設定是偵測預設值而且全部允許通過...

搞什麼啊! <( ‵□′)───C<─___-)||

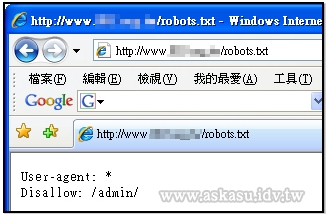

但我覺得更有問題的,是外包廠商寫在給網路蜘蛛所讀取的robots.txt 裡面,竟然明確顯示出登入後台的位址。

利用這個方式,我從該廠商的網站尋找客戶名單,果然試出很多網站都有類似問題,不乏政府機關還有上櫃上市的大型企業。

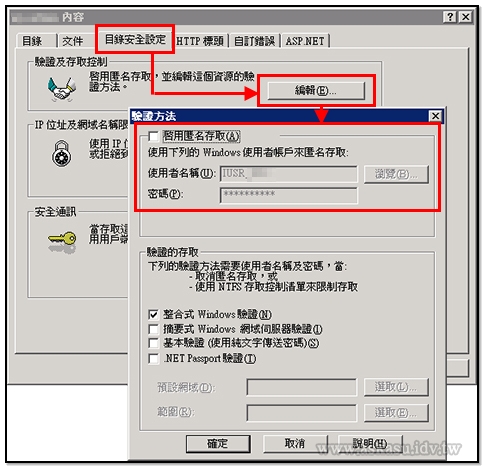

如果不想讓網路蜘蛛爬進後台站點,比較安全的作法應該是用網頁伺服器,在進入後台的位址就不開放匿名存取吧。更何況某些惡劣的搜尋引擎,根本就不理會robots.txt 裡撰寫的限制。

不過這個方法,不適用於我處理的這個網站。因為外包廠商不知道怎麼寫網站的,當我把後台位址關掉匿名存取後,竟然造成網站每個頁面都會跳出要求登入的視窗,只好放棄!

但是我想,有robots.txt 問題的網站,應該不單只有這個廠商的客戶群而已...

發佈留言